Measure of the joint variability

O sinal da covariância de duas variáveis aleatórias

X e

Y

Este artigo é sobre o grau em que as variáveis aleatórias variam de forma semelhante. Para outros usos, consulte

Covariância (desambiguação) .

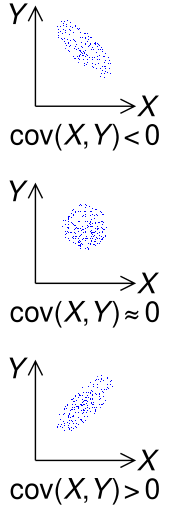

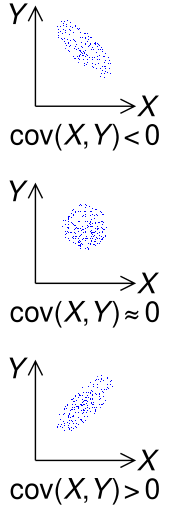

Em teoria de probabilidade e estatística , a covariância é uma medida da variabilidade conjunta de duas variáveis aleatórias . Se os valores maiores de uma variável correspondem principalmente aos valores maiores da outra variável, e o mesmo vale para os valores menores (ou seja, as variáveis tendem a mostrar um comportamento semelhante), a covariância é positiva. No caso oposto, quando os maiores valores de uma variável correspondem principalmente aos menores valores da outra (ou seja, as variáveis tendem a apresentar comportamento oposto), a covariância é negativa. O sinal da covariância mostra, portanto, a tendência na relação linear entre as variáveis. A magnitude da covariância não é fácil de interpretar porque não é normalizada e, portanto, depende das magnitudes das variáveis. A versão normalizada da covariância , o coeficiente de correlação , entretanto, mostra por sua magnitude a força da relação linear.

Uma distinção deve ser feita entre (1) a covariância de duas variáveis aleatórias, que é um parâmetro populacional que pode ser visto como uma propriedade da distribuição de probabilidade conjunta , e (2) a covariância da amostra , que além de servir como um descritor da amostra, também serve como um valor estimado do parâmetro da população.

Definição

Para duas variáveis aleatórias avaliadas em real distribuídas em conjunto e com segundos momentos finitos , a covariância é definida como o valor esperado (ou média) do produto de seus desvios de seus valores esperados individuais:

![{\ displaystyle \ operatorname {cov} (X, Y) = \ operatorname {E} {{\ big [} (X- \ operatorname {E} [X]) (Y- \ operatorname {E} [Y]) { \grande ]}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f98a8bf924edb41a8025b5ffaa1b255b4a6f48b9) |

|

( Eq.1 )

|

onde é o valor esperado de , também conhecido como a média de . A covariância também é às vezes denotada ou , em analogia à variância . Usando a propriedade de linearidade das expectativas, isso pode ser simplificado para o valor esperado de seu produto menos o produto de seus valores esperados:

![\ operatorname {E} [X]](https://wikimedia.org/api/rest_v1/media/math/render/svg/44dd294aa33c0865f58e2b1bdaf44ebe911dbf93)

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (X, Y) & = \ operatorname {E} \ left [\ left (X- \ operatorname {E} \ left [X \ right] \ right) \ esquerda (Y- \ operatorname {E} \ left [Y \ right] \ right) \ right] \\ & = \ operatorname {E} \ left [XY-X \ operatorname {E} \ left [Y \ right] - \ operatorname {E} \ left [X \ right] Y + \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] \ right] \\ & = \ operatorname {E} \ left [XY \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] + \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] \\ & = \ operatorname {E} \ left [XY \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right], \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b82a8c24b0063ffd95d8624f460acaaacb2a99b3)

mas esta equação é suscetível a um cancelamento catastrófico (veja a seção sobre computação numérica abaixo).

As unidades de medida da covariância são as vezes as de . Em contraste, os coeficientes de correlação , que dependem da covariância, são uma medida adimensional da dependência linear. (Na verdade, os coeficientes de correlação podem ser simplesmente entendidos como uma versão normalizada de covariância.)

Definição para variáveis aleatórias complexas

A covariância entre duas variáveis aleatórias complexas é definida como

![{\ displaystyle \ operatorname {cov} (Z, W) = \ operatorname {E} \ left [(Z- \ operatorname {E} [Z]) {\ overline {(W- \ operatorname {E} [W]) }} \ right] = \ operatorname {E} \ left [Z {\ overline {W}} \ right] - \ operatorname {E} [Z] \ operatorname {E} \ left [{\ overline {W}} \ direito]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cc823fe25634365b1859a3ee206ca894203a9ee2)

Observe a conjugação complexa do segundo fator na definição.

Uma pseudo-covariância relacionada também pode ser definida.

Variáveis aleatórias discretas

Se o par de variáveis aleatórias (reais) pode assumir os valores de , com probabilidades iguais , então a covariância pode ser escrita de forma equivalente em termos de médias e como

![\ operatorname {E} [X]](https://wikimedia.org/api/rest_v1/media/math/render/svg/44dd294aa33c0865f58e2b1bdaf44ebe911dbf93)

![{\ displaystyle \ operatorname {E} [Y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/639e8577c6faffc0471c7e123ead30970034e6d5)

Também pode ser expresso de forma equivalente, sem se referir diretamente aos meios, como

Mais geralmente, se houver realizações possíveis de , ou seja, mas com probabilidades possivelmente desiguais para , então a covariância é

Exemplo

Interpretação geométrica do exemplo de covariância. Cada cuboide é a caixa delimitadora de seu ponto (

x ,

y ,

f (

x ,

y )) e os meios

X e

Y (ponto magenta). A covariância é a soma dos volumes dos cubóides vermelhos menos os cubóides azuis.

Suponha que e tenha a seguinte função de massa de probabilidade conjunta , em que as seis células centrais fornecem as probabilidades conjuntas discretas das seis realizações hipotéticas :

|

x

|

|

|

| 5

|

6

|

7

|

|

y

|

8

|

0

|

0,4

|

0,1

|

0,5

|

| 9

|

0,3

|

0

|

0,2

|

0,5

|

|

|

|

0,3

|

0,4

|

0,3

|

1

|

pode assumir três valores (5, 6 e 7), enquanto pode assumir dois (8 e 9). Seus meios são e . Então,

pode assumir três valores (5, 6 e 7), enquanto pode assumir dois (8 e 9). Seus meios são e . Então,

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (X, Y) = {} & \ sigma _ {XY} = \ sum _ {(x, y) \ in S} f (x, y) \ esquerda (x- \ mu _ {X} \ direita) \ esquerda (y- \ mu _ {Y} \ direita) \\ [4pt] = {} & (0) (5-6) (8-8,5) + (0,4) (6-6) (8-8,5) + (0,1) (7-6) (8-8,5) + {} \\ [4pt] & (0,3) (5-6) (9-8,5) + (0) (6-6) (9-8,5) + (0,2) (7-6) (9-8,5) \\ [4pt] = {} & {- 0,1} \;. \ End {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8a80fa4db641ca7ddd6f7a3fee8620eed15321a7)

Propriedades

Covariância consigo mesma

A variância é um caso especial de covariância em que as duas variáveis são idênticas (ou seja, em que uma variável sempre assume o mesmo valor que a outra):

Covariância de combinações lineares

Se , , , e são de valor real, variáveis aleatórias e são constantes com valor real, então os seguintes fatos são uma consequência da definição de covariância:

Para uma sequência de variáveis aleatórias em valores reais e constantes , temos

Identidade de covariância de Hoeffding

Uma identidade útil para calcular a covariância entre duas variáveis aleatórias é a identidade de covariância de Hoeffding:

onde é a função de distribuição cumulativa conjunta do vetor aleatório e são os marginais .

Incorrelação e independência

Variáveis aleatórias cuja covariância é zero são chamadas de não correlacionadas . Da mesma forma, os componentes de vetores aleatórios cuja matriz de covariância é zero em cada entrada fora da diagonal principal também são chamados de não correlacionados.

Se e forem variáveis aleatórias independentes , sua covariância será zero. Isso ocorre porque sob a independência,

![{\ displaystyle \ operatorname {E} [XY] = \ operatorname {E} [X] \ cdot \ operatorname {E} [Y].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c0c2870ec57051083bd6262aa4069a2500dfda44)

O inverso, entretanto, geralmente não é verdadeiro. Por exemplo, deixe ser distribuído uniformemente e deixe . Claramente, e não são independentes, mas

![[-1,1]](https://wikimedia.org/api/rest_v1/media/math/render/svg/51e3b7f14a6f70e614728c583409a0b9a8b9de01)

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (X, Y) & = \ operatorname {cov} \ left (X, X ^ {2} \ right) \\ & = \ operatorname {E} \ left [X \ cdot X ^ {2} \ right] - \ operatorname {E} [X] \ cdot \ operatorname {E} \ left [X ^ {2} \ right] \\ & = \ operatorname {E} \ left [X ^ {3} \ right] - \ operatorname {E} [X] \ operatorname {E} \ left [X ^ {2} \ right] \\ & = 0-0 \ cdot \ operatorname {E} [X ^ {2}] \\ & = 0. \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/19b6f2d636d5ef9ba85b6350e49222109a28d665)

Nesse caso, a relação entre e é não linear, enquanto a correlação e a covariância são medidas de dependência linear entre duas variáveis aleatórias. Este exemplo mostra que, se duas variáveis aleatórias não estiverem correlacionadas, isso não significa em geral que sejam independentes. No entanto, se duas variáveis são conjuntamente distribuídos normalmente (mas não se eles são meramente individualmente normalmente distribuído ), uncorrelatedness faz implicam independência.

Relacionamento com produtos internos

Muitas das propriedades de covariância podem ser extraídas elegantemente, observando que ela satisfaz propriedades semelhantes às de um produto interno :

-

bilinear : para constantes e variáveis aleatórias ,

- simétrico:

-

semi-definida positiva : para todas as variáveis aleatórias , e implica que é constante quase com certeza .

Na verdade, essas propriedades implicam que a covariância define um produto interno sobre o espaço vetorial quociente obtido tomando o subespaço de variáveis aleatórias com segundo momento finito e identificando quaisquer dois que diferem por uma constante. (Essa identificação transforma a semi-definição positiva acima em definição positiva.) Esse espaço vetorial quociente é isomórfico ao subespaço de variáveis aleatórias com segundo momento finito e zero médio; nesse subespaço, a covariância é exatamente o produto interno L 2 das funções de valor real no espaço amostral.

Como resultado, para variáveis aleatórias com variância finita, a desigualdade

vale através da desigualdade de Cauchy-Schwarz .

Prova: se , então é trivial. Caso contrário, deixe a variável aleatória

Então nós temos

![{\ displaystyle {\ begin {alinhados} 0 \ leq \ sigma ^ {2} (Z) & = \ operatorname {cov} \ left (X - {\ frac {\ operatorname {cov} (X, Y)} {\ sigma ^ {2} (Y)}} Y, \; X - {\ frac {\ operatorname {cov} (X, Y)} {\ sigma ^ {2} (Y)}} Y \ direita) \\ [ 12pt] & = \ sigma ^ {2} (X) - {\ frac {(\ operatorname {cov} (X, Y)) ^ {2}} {\ sigma ^ {2} (Y)}}. \ End {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fc8741ab12cb5943efe9d8dbfeb455517bc63347)

Calculando a covariância da amostra

As covariâncias da amostra entre as variáveis com base nas observações de cada uma, extraídas de uma população não observada de outra forma, são fornecidas pela matriz com as entradas

![{\ displaystyle \ textstyle {\ overline {\ mathbf {q}}} = \ left [q_ {jk} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cb28ac928a2a379d039d27fb99d56dd21c1c027c)

que é uma estimativa da covariância entre a variável e a variável .

A média da amostra e a matriz de covariância da amostra são estimativas imparciais da média e da matriz de covariância do vetor aleatório , um vetor cujo j- ésimo elemento é uma das variáveis aleatórias. A razão pela qual a matriz de covariância da amostra tem no denominador em vez de essencialmente é que a média da população não é conhecida e é substituída pela média da amostra . Se a média da população for conhecida, a estimativa não enviesada análoga é dada por

-

.

.

Generalizações

Matriz de autocovariância de vetores aleatórios reais

Para um vetor de variáveis aleatórias distribuídas em conjunto com segundos momentos finitos, sua matriz de autocovariância (também conhecida como matriz de variância-covariância ou simplesmente a matriz de covariância ) (também denotada por ou ) é definida como

![{\ displaystyle {\ begin {alinhado} \ operatorname {K} _ {\ mathbf {XX}} = \ operatorname {cov} (\ mathbf {X}, \ mathbf {X}) & = \ operatorname {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ mathrm {T}} \ direita] \\ & = \ operatorname {E} \ left [\ mathbf {XX} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf {X}] \ operatorname {E} [\ mathbf {X}] ^ {\ mathrm {T}}. \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/15725714f72a46ffb0686bafdb209260b842ac39)

Seja um vetor aleatório com matriz de covariância Σ , e seja A uma matriz que pode atuar à esquerda. A matriz de covariância do produto matriz-vetor AX é:

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (\ mathbf {AX}, \ mathbf {AX}) & = \ operatorname {E} \ left [\ mathbf {AX (A} \ mathbf {X)} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf {AX}] \ operatorname {E} \ left [(\ mathbf {A} \ mathbf {X}) ^ {\ mathrm {T }} \ right] \\ & = \ operatorname {E} \ left [\ mathbf {AXX} ^ {\ mathrm {T}} \ mathbf {A} ^ {\ mathrm {T}} \ right] - \ operatorname { E} [\ mathbf {AX}] \ operatorname {E} \ left [\ mathbf {X} ^ {\ mathrm {T}} \ mathbf {A} ^ {\ mathrm {T}} \ right] \\ & = \ mathbf {A} \ operatorname {E} \ left [\ mathbf {XX} ^ {\ mathrm {T}} \ right] \ mathbf {A} ^ {\ mathrm {T}} - \ mathbf {A} \ operatorname {E} [\ mathbf {X}] \ operatorname {E} \ left [\ mathbf {X} ^ {\ mathrm {T}} \ right] \ mathbf {A} ^ {\ mathrm {T}} \\ & = \ mathbf {A} \ left (\ operatorname {E} \ left [\ mathbf {XX} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf {X}] \ operatorname {E } \ left [\ mathbf {X} ^ {\ mathrm {T}} \ right] \ right) \ mathbf {A} ^ {\ mathrm {T}} \\ & = \ mathbf {A} \ Sigma \ mathbf { A} ^ {\ mathrm {T}}. \ End {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c1b2123c32a8acefc209a4f69d571ee1197a8c59)

Isso é um resultado direto da linearidade da expectativa e é útil ao aplicar uma transformação linear , como uma transformação de clareamento , a um vetor.

Matriz de covariância cruzada de vetores aleatórios reais

Para vetores aleatórios reais e , a matriz de covariância cruzada é igual a

![{\ displaystyle {\ begin {alinhado} \ operatorname {K} _ {\ mathbf {X} \ mathbf {Y}} = \ operatorname {cov} (\ mathbf {X}, \ mathbf {Y}) & = \ operatorname {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {Y} - \ operatorname {E} [\ mathbf {Y}]) ^ {\ mathrm {T}} \ right] \\ & = \ operatorname {E} \ left [\ mathbf {X} \ mathbf {Y} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf { X}] \ operatorname {E} [\ mathbf {Y}] ^ {\ mathrm {T}} \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/99e6f5ef675f7bb826d04f206bd212d14632ab8c) |

|

( Eq.2 )

|

onde é a transposta do vetor (ou matriz) .

O -ésimo elemento desta matriz é igual à covariância entre o i -ésimo componente escalar de e o j -ésimo componente escalar de . Em particular, é a transposição de .

Computação numérica

Quando , a equação está sujeita ao cancelamento catastrófico se e não for calculada com exatidão e, portanto, deve ser evitada em programas de computador quando os dados não foram centralizados antes. Algoritmos numericamente estáveis devem ser preferidos neste caso.

![\ operatorname {E} [XY] \ approx \ operatorname {E} [X] \ operatorname {E} [Y]](https://wikimedia.org/api/rest_v1/media/math/render/svg/5cc8091d0da21aa8f5a114797ba5113ddf534f69)

![{\ displaystyle \ operatorname {cov} (X, Y) = \ operatorname {E} \ left [XY \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bdf56a30f7ff1be354713f144bfd02ba949a77f4)

![{\ displaystyle \ operatorname {E} \ left [XY \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/128f7734bafe2a92d25d3df5fbb614e1d22b2e45)

![{\ displaystyle \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f05701ae57cc8e32cd812037d7ba5d3d433021d4)

A covariância às vezes é chamada de medida de "dependência linear" entre as duas variáveis aleatórias. Isso não significa a mesma coisa que no contexto da álgebra linear (ver dependência linear ). Quando a covariância é normalizada, obtém-se o coeficiente de correlação de Pearson , que dá a bondade do ajuste para a melhor função linear possível que descreve a relação entre as variáveis. Nesse sentido, a covariância é um indicador linear de dependência.

Formulários

Em genética e biologia molecular

A covariância é uma medida importante em biologia . Certas sequências de DNA são conservadas mais do que outras entre as espécies e, portanto, para estudar estruturas secundárias e terciárias de proteínas , ou de estruturas de RNA , as sequências são comparadas em espécies intimamente relacionadas. Se forem encontradas alterações de sequência ou nenhuma alteração for encontrada no RNA não codificador (como microRNA ), as sequências são consideradas necessárias para motivos estruturais comuns, como uma alça de RNA. Em genética, a covariância serve de base para o cálculo da Matriz de Relacionamento Genético (GRM) (também conhecida como matriz de parentesco), permitindo inferência na estrutura da população da amostra sem parentes próximos conhecidos, bem como inferência na estimativa da herdabilidade de características complexas.

Na teoria da evolução e seleção natural , a equação de Price descreve como uma característica genética muda em frequência ao longo do tempo. A equação usa uma covariância entre uma característica e aptidão , para dar uma descrição matemática da evolução e seleção natural. Ele fornece uma maneira de compreender os efeitos que a transmissão gênica e a seleção natural têm na proporção de genes em cada nova geração de uma população. A equação de Price foi derivada por George R. Price , para derivar novamente o trabalho de WD Hamilton sobre seleção de parentesco . Exemplos da equação de preço foram construídos para vários casos evolutivos.

Em economia financeira

As covariâncias desempenham um papel fundamental na economia financeira , especialmente na moderna teoria de portfólio e no modelo de precificação de ativos de capital . As covariâncias entre os retornos de vários ativos são usadas para determinar, sob certas premissas, os valores relativos de diferentes ativos que os investidores devem (em uma análise normativa ) ou estão previstos (em uma análise positiva ) escolher manter em um contexto de diversificação .

Na assimilação de dados meteorológicos e oceanográficos

A matriz de covariância é importante para estimar as condições iniciais necessárias para a execução de modelos de previsão do tempo, um procedimento conhecido como assimilação de dados . A 'matriz de covariância de erro de previsão' é normalmente construída entre perturbações em torno de um estado médio (uma média climatológica ou de conjunto). A 'matriz de covariância do erro de observação' é construída para representar a magnitude dos erros observacionais combinados (na diagonal) e os erros correlacionados entre as medições (fora da diagonal). Este é um exemplo de sua ampla aplicação à filtragem de Kalman e estimativa de estado mais geral para sistemas que variam no tempo.

Em micrometeorologia

A técnica de covariância turbulenta é uma técnica chave de medição atmosférica onde a covariância entre o desvio instantâneo na velocidade do vento vertical do valor médio e o desvio instantâneo na concentração de gás é a base para o cálculo dos fluxos turbulentos verticais.

Em processamento de sinal

A matriz de covariância é usada para capturar a variabilidade espectral de um sinal.

Em estatísticas e processamento de imagens

A matriz de covariância é usada na análise de componentes principais para reduzir a dimensionalidade do recurso no pré-processamento de dados .

Veja também

Referências

![{\ displaystyle \ operatorname {cov} (X, Y) = \ operatorname {E} {{\ big [} (X- \ operatorname {E} [X]) (Y- \ operatorname {E} [Y]) { \grande ]}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f98a8bf924edb41a8025b5ffaa1b255b4a6f48b9)

![\ operatorname {E} [X]](https://wikimedia.org/api/rest_v1/media/math/render/svg/44dd294aa33c0865f58e2b1bdaf44ebe911dbf93)

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (X, Y) & = \ operatorname {E} \ left [\ left (X- \ operatorname {E} \ left [X \ right] \ right) \ esquerda (Y- \ operatorname {E} \ left [Y \ right] \ right) \ right] \\ & = \ operatorname {E} \ left [XY-X \ operatorname {E} \ left [Y \ right] - \ operatorname {E} \ left [X \ right] Y + \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] \ right] \\ & = \ operatorname {E} \ left [XY \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] + \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] \\ & = \ operatorname {E} \ left [XY \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right], \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b82a8c24b0063ffd95d8624f460acaaacb2a99b3)

![{\ displaystyle \ operatorname {cov} (Z, W) = \ operatorname {E} \ left [(Z- \ operatorname {E} [Z]) {\ overline {(W- \ operatorname {E} [W]) }} \ right] = \ operatorname {E} \ left [Z {\ overline {W}} \ right] - \ operatorname {E} [Z] \ operatorname {E} \ left [{\ overline {W}} \ direito]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cc823fe25634365b1859a3ee206ca894203a9ee2)

![{\ displaystyle \ operatorname {E} [Y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/639e8577c6faffc0471c7e123ead30970034e6d5)

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (X, Y) = {} & \ sigma _ {XY} = \ sum _ {(x, y) \ in S} f (x, y) \ esquerda (x- \ mu _ {X} \ direita) \ esquerda (y- \ mu _ {Y} \ direita) \\ [4pt] = {} & (0) (5-6) (8-8,5) + (0,4) (6-6) (8-8,5) + (0,1) (7-6) (8-8,5) + {} \\ [4pt] & (0,3) (5-6) (9-8,5) + (0) (6-6) (9-8,5) + (0,2) (7-6) (9-8,5) \\ [4pt] = {} & {- 0,1} \;. \ End {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8a80fa4db641ca7ddd6f7a3fee8620eed15321a7)

![{\ displaystyle \ operatorname {E} [XY] = \ operatorname {E} [X] \ cdot \ operatorname {E} [Y].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c0c2870ec57051083bd6262aa4069a2500dfda44)

![[-1,1]](https://wikimedia.org/api/rest_v1/media/math/render/svg/51e3b7f14a6f70e614728c583409a0b9a8b9de01)

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (X, Y) & = \ operatorname {cov} \ left (X, X ^ {2} \ right) \\ & = \ operatorname {E} \ left [X \ cdot X ^ {2} \ right] - \ operatorname {E} [X] \ cdot \ operatorname {E} \ left [X ^ {2} \ right] \\ & = \ operatorname {E} \ left [X ^ {3} \ right] - \ operatorname {E} [X] \ operatorname {E} \ left [X ^ {2} \ right] \\ & = 0-0 \ cdot \ operatorname {E} [X ^ {2}] \\ & = 0. \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/19b6f2d636d5ef9ba85b6350e49222109a28d665)

![{\ displaystyle {\ begin {alinhados} 0 \ leq \ sigma ^ {2} (Z) & = \ operatorname {cov} \ left (X - {\ frac {\ operatorname {cov} (X, Y)} {\ sigma ^ {2} (Y)}} Y, \; X - {\ frac {\ operatorname {cov} (X, Y)} {\ sigma ^ {2} (Y)}} Y \ direita) \\ [ 12pt] & = \ sigma ^ {2} (X) - {\ frac {(\ operatorname {cov} (X, Y)) ^ {2}} {\ sigma ^ {2} (Y)}}. \ End {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fc8741ab12cb5943efe9d8dbfeb455517bc63347)

![{\ displaystyle \ textstyle {\ overline {\ mathbf {q}}} = \ left [q_ {jk} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cb28ac928a2a379d039d27fb99d56dd21c1c027c)

![{\ displaystyle {\ begin {alinhado} \ operatorname {K} _ {\ mathbf {XX}} = \ operatorname {cov} (\ mathbf {X}, \ mathbf {X}) & = \ operatorname {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) ^ {\ mathrm {T}} \ direita] \\ & = \ operatorname {E} \ left [\ mathbf {XX} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf {X}] \ operatorname {E} [\ mathbf {X}] ^ {\ mathrm {T}}. \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/15725714f72a46ffb0686bafdb209260b842ac39)

![{\ displaystyle {\ begin {alinhado} \ operatorname {cov} (\ mathbf {AX}, \ mathbf {AX}) & = \ operatorname {E} \ left [\ mathbf {AX (A} \ mathbf {X)} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf {AX}] \ operatorname {E} \ left [(\ mathbf {A} \ mathbf {X}) ^ {\ mathrm {T }} \ right] \\ & = \ operatorname {E} \ left [\ mathbf {AXX} ^ {\ mathrm {T}} \ mathbf {A} ^ {\ mathrm {T}} \ right] - \ operatorname { E} [\ mathbf {AX}] \ operatorname {E} \ left [\ mathbf {X} ^ {\ mathrm {T}} \ mathbf {A} ^ {\ mathrm {T}} \ right] \\ & = \ mathbf {A} \ operatorname {E} \ left [\ mathbf {XX} ^ {\ mathrm {T}} \ right] \ mathbf {A} ^ {\ mathrm {T}} - \ mathbf {A} \ operatorname {E} [\ mathbf {X}] \ operatorname {E} \ left [\ mathbf {X} ^ {\ mathrm {T}} \ right] \ mathbf {A} ^ {\ mathrm {T}} \\ & = \ mathbf {A} \ left (\ operatorname {E} \ left [\ mathbf {XX} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf {X}] \ operatorname {E } \ left [\ mathbf {X} ^ {\ mathrm {T}} \ right] \ right) \ mathbf {A} ^ {\ mathrm {T}} \\ & = \ mathbf {A} \ Sigma \ mathbf { A} ^ {\ mathrm {T}}. \ End {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c1b2123c32a8acefc209a4f69d571ee1197a8c59)

![{\ displaystyle {\ begin {alinhado} \ operatorname {K} _ {\ mathbf {X} \ mathbf {Y}} = \ operatorname {cov} (\ mathbf {X}, \ mathbf {Y}) & = \ operatorname {E} \ left [(\ mathbf {X} - \ operatorname {E} [\ mathbf {X}]) (\ mathbf {Y} - \ operatorname {E} [\ mathbf {Y}]) ^ {\ mathrm {T}} \ right] \\ & = \ operatorname {E} \ left [\ mathbf {X} \ mathbf {Y} ^ {\ mathrm {T}} \ right] - \ operatorname {E} [\ mathbf { X}] \ operatorname {E} [\ mathbf {Y}] ^ {\ mathrm {T}} \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/99e6f5ef675f7bb826d04f206bd212d14632ab8c)

![\ operatorname {E} [XY] \ approx \ operatorname {E} [X] \ operatorname {E} [Y]](https://wikimedia.org/api/rest_v1/media/math/render/svg/5cc8091d0da21aa8f5a114797ba5113ddf534f69)

![{\ displaystyle \ operatorname {cov} (X, Y) = \ operatorname {E} \ left [XY \ right] - \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right] ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bdf56a30f7ff1be354713f144bfd02ba949a77f4)

![{\ displaystyle \ operatorname {E} \ left [XY \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/128f7734bafe2a92d25d3df5fbb614e1d22b2e45)

![{\ displaystyle \ operatorname {E} \ left [X \ right] \ operatorname {E} \ left [Y \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f05701ae57cc8e32cd812037d7ba5d3d433021d4)